Hvad er de 4 risikoniveauer i EU's AI Act - og hvad er forpligtelserne?

- april 18, 2024

EU’s AI Act skelner mellem fire risikoniveauer indenfor AI-systemer. De afgør, hvilke forpligtelser der gælder for udviklingen eller brugen af AI-systemet.

De 4 risikoniveauer er:

Og i dette blogindlæg fortæller vi dig alt, hvad du behøver at vide om dem – og ikke mindst de forpligtelser, der følger med.

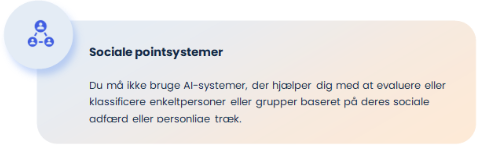

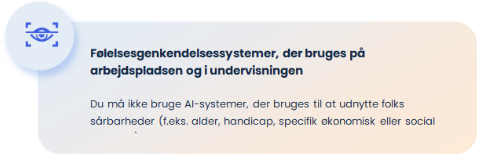

Hvad er forbudte AI-systemer?

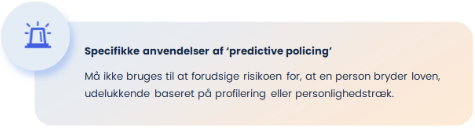

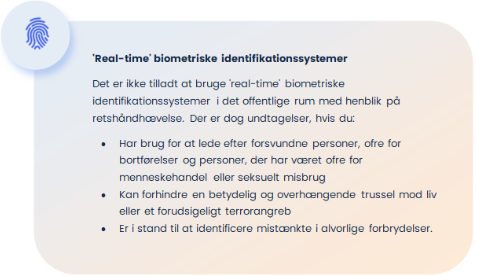

AI Act peger på flere AI-systemer, som er ulovlige at bruge, fordi de anses for at være en trussel mod mennesker. I kategorien af forbudte AI-værktøjer er der 8 systemer:

Hvad er højrisiko AI-systemer?

Efter at have set udkastet til den endelige tekst til AI-forordningen, ved vi, at der er nogle nuancer i forhold til, hvornår et system er højrisiko:

Højrisiko AI-systemer er systemer, der skader sundhed, sikkerhed og grundlæggende rettigheder.

Derfor vil de systemer, der ikke vil blive inkluderet her, være systemer, der kun udfører begrænsede handlinger eller blot forbedrer en handling, der udføres af mennesker.

De er opdelt i to kategorier afhængigt af, om AI-systemerne:

- Anvendes i produkter, der er omfattet af EU’s produktsikkerheds-forordning (herunder legetøj, luftfart, biler, medicinsk udstyr og elevatorer) og skal gennemgå en tredjeparts overensstemmelses-vurdering i henhold til disse bilag II-love.

- Falder ind under de 8 følgende områder og skal registreres i en EU-database:

- Biometri (som bruges til identifikation og kategorisering af mennesker)

- Kritisk infrastruktur

- Uddannelse og erhvervsuddannelse

- Beskæftigelse, ledelse og adgang til selvstændig virksomhed

- Adgang til og udnyttelse af vigtige private tjenester og offentlige tjenester og ydelser

- Retshåndhævelse

- Migration, asyl og grænsekontrol

- Hjælp til juridisk fortolkning og anvendelse af loven.

Et AI-system er desuden altid højrisiko, hvis det profilerer enkeltpersoner.

Centrale forpligtelser for udbydere af højrisiko AI-systemer

De fleste forpligtelser i AI-forordningen gælder for udbydere af højrisiko AI-systemer. Disse forpligtelser omfatter:

- Implementering af risikostyringssystem i hele AI-systemets livscyklus

- Gennemførelse af data-governance

- Registrering i offentlig EU-database for højrisiko AI-systemer (gælder kun for AI-systemer, der bruges inden for de 8 områder i kategori 2 – se afsnittet om højrisiko AI-systemer ovenfor)

- Udarbejdelse af teknisk dokumentation for at sikre gennemsigtighed (fx brugsanvisninger og tydelig information til fysiske’ personer)

- Design af logningsfunktioner og menneskelige overvågningsmekanismer i systemerne (for eksempel ved at være nemme at forklare og fortolke, reviderbare logfiler og human-in-the-loop).

- Passende niveauer af nøjagtighed, robusthed og cybersikkerhed (passende betyder fx relevant, repræsentativ, fri for fejl og komplet).

- Gennemførelse af vurderinger af grundlæggende rettigheder

- Implementering et kvalitetsstyringssystem.

Centrale forpligtelser for brugere af højrisiko AI-systemer

Brugere af højrisiko AI-systemer har forskellige forpligtelser med hensyn til brugen og overvågningen af disse systemer. De omfatter:

- Sikring af menneskeligt tilsyn, og at den pågældende person har den rette kompetence

- Overvågning af driften af højrisiko AI-systemet på baggrund af brugsanvisningen

- Opbevaring af logfiler i mindst seks måneder (som udgangspunkt)

- Gennemførelse af DPIA’er (konsekvensanalyser).

Hvad er AI-systemer med begrænset risiko?

AI-systemer med begrænset risiko skal leve op til minimale krav om gennemsigtighed.

I dette tilfælde betyder det, at du er forpligtet til at informere mennesker om, at de interagerer med en AI, eller at AI-genereret indhold er mærket som sådan. Dette er baseret på tanken om, at folk har ret til at vide, hvornår de interagerer med AI eller AI-genereret indhold.

Hvad er AI-systemer med minimal risiko?

AI-forordningen tillader fri brug af AI med minimal (eller ingen) risiko. Dette omfatter applikationer som AI-aktiverede videospil eller spamfiltre. De fleste AI-systemer, der i øjeblikket bruges i EU, er AI-systemer med minimal risiko.

Én ting er at vide, hvordan man sikrer en ansvarlig praksis, når det gælder brugen af AI. En anden ting er rent faktisk at handle på det. Vi hjælper dig hele vejen med denne praktiske guide til AI-forordnigen – hent dit eget eksemplar gratis.